Das Scheitern der VN-Expertengespräche zu Autonomen Waffensystemen

Alternative Formate rücken in den Fokus

SWP-Aktuell 2022/A 36, 07.06.2022, 8 Seitendoi:10.18449/2022A36

ForschungsgebieteDie Group of Governmental Experts (GGE) diskutiert seit 2017 im Rahmen des Waffenübereinkommens der Vereinten Nationen (VN) über Autonome Waffensysteme (AWS). Russland hat die jüngste Verhandlungsrunde im März in Genf boykottiert. Grund für dieses Verhalten Russlands ist sein seit dem 24. Februar 2022 dauernder Angriffskrieg gegen die Ukraine. Eine Regulierung von AWS ist damit in noch weitere Ferne gerückt. Staaten sprechen mit vorgehaltener Hand bereits von einem Scheitern der Genfer Verhandlungen. Deutschlands Ankündigung im Koalitionsvertrag, die Ächtung von AWS aktiv voranzutreiben, scheint nun zur Mammutaufgabe zu werden. Da die GGE auf dem Konsensprinzip beruht und eine konstruktive Zusammenarbeit mit Russland in naher Zukunft nicht zu erwarten ist, müssen andere Foren für eine internationale Debatte zu AWS gefunden werden. Deutschland muss sich auf Optionen innerhalb der Nato, der Europäischen Union (EU) und der VN vorbereiten. Klar ist, dass nur ein kohärentes Vorgehen mit den Nato-Bündnispartnern auf sämtlichen Ebenen zielführend ist. Um dies zu erreichen, bedarf es einer klaren nationalen Positionierung Deutschlands zum Umgang mit AWS.

Im März fand in Genf die erste von zwei GGEs zu AWS in diesem Jahr statt. Russland nutzte das Forum als Bühne für die Rechtfertigung seines völkerrechtswidrigen Angriffskrieges gegen die Ukraine. Zahlreiche Staaten, darunter Deutschland, haben die russische Invasion aufs Schärfste verurteilt; während der Schlusssätze der russischen Delegation am Ende der GGE verließen die meisten Delegierten demonstrativ den Saal.

Das angespannte Klima inmitten bestehender Großmachtrivalitäten, das seinen traurigen Höhepunkt in Putins Angriffskrieg gegen die Ukraine gefunden hat, hat schon jetzt zu einem faktischen Scheitern der Genfer Verhandlungen geführt, obwohl die Gruppe im Juli erneut für fünf Tage zusammenkommen wird. Ohne russische Beteiligung ist eine Regulierung von AWS in der GGE nicht möglich, da Entscheidungen nur konsensual getroffen werden können. An der GGE können alle 125 Vertragsstaaten der Konvention über bestimmte konventionelle Waffen (Convention on Certain Conventional Weapons, CCW) teilnehmen und auch Unterzeichnerstaaten, wie beispielsweise Ägypten, haben ein Rederecht. De facto beteiligen sich aber nur rund 80 Staaten an der GGE.

Inhaltliche Verwerfungslinien innerhalb der GGE

Inhaltliche Verwerfungen in der Expertengruppe zeichneten sich bereits vor dem russischen Angriffskrieg ab; sie machten eine baldige inhaltliche Einigung schon damals unwahrscheinlich.

Zum einen hat die GGE bislang keine gemeinsame Definition von AWS gefunden. Die meisten Staaten bevorzugen den Vorschlag des Internationalen Komitees vom Roten Kreuz (IKRK), wonach ein AWS ein Waffensystem ist, das sowohl die Zielauswahl als auch den Angriff ohne menschliches Handeln vornehmen kann. Doch nicht alle Staaten unterstützen diesen Vorschlag. China versteht unter AWS nur solche Systeme, die imstande sind, eine strategische Mission selbstständig abzuändern oder zu ergänzen. Andere Staaten wiederum halten es nicht für erforderlich, AWS überhaupt zu definieren. Viel wichtiger sei es, die notwendige Mensch-Maschine-Interaktion ins Zentrum zu stellen.

Frankreich hat 2021 die Initiative ergriffen und eine eigene Definition von AWS in der GGE präsentiert, die auch Deutschland unterstützt. Die beiden Länder unterscheiden zwischen vollautonomen (Fully Autonomous Lethal Weapon Systems, LAWS) und teilautonomen (Partially Autonomous Lethal Weapon Systems, PLAWS) Waffensystemen. Vollautonome Waffensysteme seien solche, die ohne menschliches Zutun imstande sind, die Zielauswahl und die Entscheidung zum Angriff vorzunehmen. Ferner seien sie in der Lage, die strategische Mission abzuändern. Diese Art Waffensysteme sollten nach Ansicht Deutschlands und Frankreichs gänzlich verboten werden. Teilautonome Waffensysteme seien hingegen solche, die innerhalb eines durch den Menschen vorgegebenen Handlungsrahmens Ziele selbstständig auswählen und attackieren können, aber keinesfalls darüber hinausgehende, eigenständige Entscheidungen treffen können. Derartige Waffensysteme müssten entsprechend reguliert werden, um zu gewährleisten, dass sie im Einklang mit rechtlichen und ethischen Prinzipien eingesetzt würden. Unter anderem Japan hat bereits Interesse gezeigt, die Diskussion über diesen Definitionsvorschlag zu vertiefen.

Zum anderen herrscht keine Einigkeit darüber, welcher Begriff geeignet ist, das notwendige Ausmaß menschlicher Steuerungskompetenz über Maschinen zu bezeichnen. Während ein signifikanter Anteil an Staaten innerhalb der GGE den Begriff der »menschlichen Kontrolle« (human control) bevorzugt, ziehen zum Beispiel die USA das Konzept der »angemessenen menschlichen Beurteilung« (human judgment) vor. Die USA verstehen das Konzept der menschlichen Kontrolle als direkten, manuellen Eingriff in ein Waffensystem; jedoch wollen sie in erster Linie die Effekte von AWS kontrollieren und weniger das Waffensystem selbst. Verfechter des Konzepts der menschlichen Kontrolle dagegen wollen ein Waffensystem und nicht nur dessen Effekte kontrollieren.

Eine weitere Verwerfungslinie ist der Rüstungswettlauf zwischen den USA, Russland und China, der sich insbesondere auf dem Gebiet der neuen Technologien abzeichnet. Vor allem China hat die Modernisierung seiner Landesverteidigung durch einen massiven Anstieg seiner Militärausgaben in den Fokus gerückt und verkündet, bis spätestens 2030 die weltweite Supermacht im Bereich der künstlichen Intelligenz (KI, engl. AI) sein zu wollen. Zwar spricht sich China für eine Regulierung von AWS in der GGE aus, doch die enge chinesische Definition von AWS lässt befürchten, dass China – womöglich aufgrund seiner machtpolitischen Bestrebungen – diese nicht wirklich einer Regulierung unterwerfen möchte.

Die momentan wohl stärksten Spannungen bestehen allerdings zwischen den USA (beziehungsweise den Nato-Staaten) und Russland. Wenngleich Russland einen ausreichenden menschlichen Einfluss über AWS für unverzichtbar erklärt hat, ist es gegen eine weiterführende völkerrechtliche Regulierung, die über den existierenden Rechtsrahmen hinausgeht. An diesem Standpunkt hält Russland vehement fest, sodass eine Einigung in der GGE nur schwer vorstellbar ist. Deswegen wird schon jetzt überlegt, ob nicht andere Foren geeigneter wären, die Diskussion voranzubringen. Deutschland sollte sich auf solche Szenarien vorbereiten. Zum Beispiel könnte das Bundesministerium der Verteidigung federführend im Zusammenspiel mit dem Auswärtigen Amt eine nationale Positionierung zu AWS verabschieden.

Nationale Positionierung Deutschlands zu AWS

Anders als Frankreich hat Deutschland bislang keine nationale Positionierung zu AWS vorgelegt. Die KI-Strategie der Bundesregierung von 2018 befasst sich nur unzureichend mit der militärischen Nutzung von KI. Daher bleibt es lediglich bei der Äußerung im Koalitionsvertrag, die Ächtung letaler autonomer Waffensysteme, »die vollständig der Verfügung des Menschen entzogen sind«, aktiv voranzutreiben. Grund für die fehlende nationale Positionsbestimmung könnten einerseits unterschiedliche Auffassungen zwischen Außen- und Verteidigungsministerium zu AWS sein. Andererseits möchte man nicht ohne vorherige Abstimmung mit Bündnispartnern wie den USA, Frankreich und den Niederlanden agieren. Zwar haben sowohl die USA als auch Frankreich bereits nationale Positionierungen zu AWS verabschiedet; doch es scheint, dass Deutschland die kommenden Monate und insbesondere die weitere Entwicklung des Krieges in der Ukraine abwarten möchte.

Eine nationale Positionierung könnte unter anderem die im Rahmen der Genfer Verhandlungen 2021 von Frankreich und Deutschland getroffene Unterscheidung zwischen voll- und teilautonomen Waffensystemen enthalten. Allerdings ist kritisch anzumerken, dass sowohl Frankreich als auch Deutschland nach wie vor lediglich von »letalen« Waffensystemen sprechen. Diese Eingrenzung ist aus zweierlei Gründen problematisch: Erstens können auch nichttödliche Waffen großes Leid für feindliche Kombattanten und die Zivilbevölkerung verursachen. Zweitens ist eine klare Abgrenzung zwischen tödlichen und nichttödlichen Waffen schwierig.

Eine nationale Positionierung sollte außerdem darlegen, anhand welcher Parameter der Einsatz teilautonomer Waffensysteme gestattet werden soll. Sie muss sich deshalb auch mit dem notwendigen Ausmaß der Mensch-Maschine-Interaktion beziehungsweise mit dem Konzept der menschlichen Kontrolle befassen. Die Vorarbeiten des International Panel on the Regulation of Autonomous Weapons (iPRAW), in dem die Autorinnen federführend mitarbeiten, könnten diesbezüglich wertvolle Anhaltspunkte liefern: iPRAW versteht unter menschlicher Kontrolle die Fähigkeit des Menschen, über ausreichendes Situationsverständnis (situational awareness) und entsprechende Eingriffsmöglichkeiten (options for intervention) zu verfügen. Beide Elemente müssen einerseits durch das Design des Waffensystems gewährleistet werden (control by design), andererseits während dessen Nutzung implementierbar sein (control in use). Das konkrete Ausmaß menschlicher Kontrolle hängt aber vom jeweiligen Einsatzkontext ab.

Das heißt, eine nationale Positionierung sollte die verschiedenen möglichen Szenarien, in denen AWS eingesetzt werden könnten, aufgreifen und entsprechende rote Linien identifizieren. Der Einsatz von AWS in einem urbanen Umfeld könnte beispielsweise strengeren Anforderungen unterliegen als in einem rein militärischen Umfeld. In städtischen Gebieten könnte der Mensch verpflichtet werden, den Einsatz eines AWS zu überwachen und gegebenenfalls in die Operation einzugreifen. Beim Einsatz autonomer U‑Boote wäre eine Intervention durch den Menschen indes weniger relevant.

In Anbetracht der aktuellen weltpolitischen Entwicklungen sollte sich Deutschland aber auch offen gegenüber technologischer Innovation zeigen und die militärischen Vorteile von Autonomie in Waffensystemen in seiner nationalen Positionsbestimmung berücksichtigen. Schnelligkeit, Zielgenauigkeit und der Schutz eigener Soldaten und Soldatinnen sind einige Beispiele, die mitunter für den Einsatz von AWS sprechen.

Die »Zeitenwende« und ihr Einfluss auf die nationale Positionierung zu AWS

Die Forderung nach einer nationalen Positionierung Deutschlands muss auch im Kontext der »Zeitenwende« gesehen werden: Bundeskanzler Olaf Scholz verkündete in seiner Regierungserklärung vom 27. Februar 2022, man werde »von nun an Jahr für Jahr mehr als zwei Prozent des Bruttoinlandsprodukts« für Verteidigungsausgaben verwenden. Das ebenfalls angekündigte Sondervermögen über 100 Milliarden Euro für die Bundeswehr hat der Bundestag kürzlich beschlossen. Diese Neuerungen haben im Wesentlichen zwei Auswirkungen auf eine nationale Positionierung zu AWS:

Zum einen wird Offenheit gegenüber bestehenden Rüstungsprojekten, wie dem Future Combat Air System (FCAS), signalisiert. FCAS ist ein Systemverbund (system of systems) verschiedener militärischer Wirkeinheiten der Luftstreitkräfte; Teile von FCAS sollen auch mit autonomen Funktionen ausgestattet sein. Dies steht in keinem Widerspruch zu dem im Koalitionsvertrag abgegebenen Versprechen, Waffensysteme, die vollständig der Verfügungsgewalt des Menschen entzogen sind, zu ächten. Denn im Rahmen von FCAS wurde eine Arbeitsgruppe (AG) zu Technikverantwortung geschaffen, die einen verantwortungsvollen Einsatz des Luftkampfsystems gewährleisten soll. Einer der zentralen Diskussionspunkte innerhalb der AG ist das Konzept und die konkrete Operationalisierung menschlicher Kontrolle.

Zum anderen ist im Hinblick auf die von Olaf Scholz verkündete Zeitenwende genau zu überlegen, welche Anschaffungen innerhalb des deutschen Militärs in Zukunft tatsächlich notwendig und sinnvoll sind. Um Personalkosten zu sparen, mag sich der Einsatz neuer Technologien, beispielsweise in Form von KI-basierten Datenauswertungssystemen, lohnen. Hierbei handelt es sich indes nicht um AWS – doch die Fragen, die die zunehmende Nutzung von KI aufwirft, ähneln sich, unabhängig davon, wo und wofür sie eingesetzt wird.

Die Zeitenwende bedeutet daher nicht, dass die im Koalitionsvertrag formulierte Ächtung von AWS mit einer generellen Ablehnung technologischer Innovation im militärischen Bereich verbunden wäre. Im Gegenteil, eine nationale Positionierung zu AWS sollte ein klares Bekenntnis zur Notwendigkeit von Forschung und Entwicklung zu Militärtechnologien enthalten sowie deren Vorteile benennen. Denn erst eine entsprechend differenzierte nationale Positionierung wird es Deutschland ermöglichen, in den künftigen Verhandlungen aktiv und in Abstimmung mit den Bündnispartnern mitzuwirken.

Alternative Foren zur Regulierung von AWS

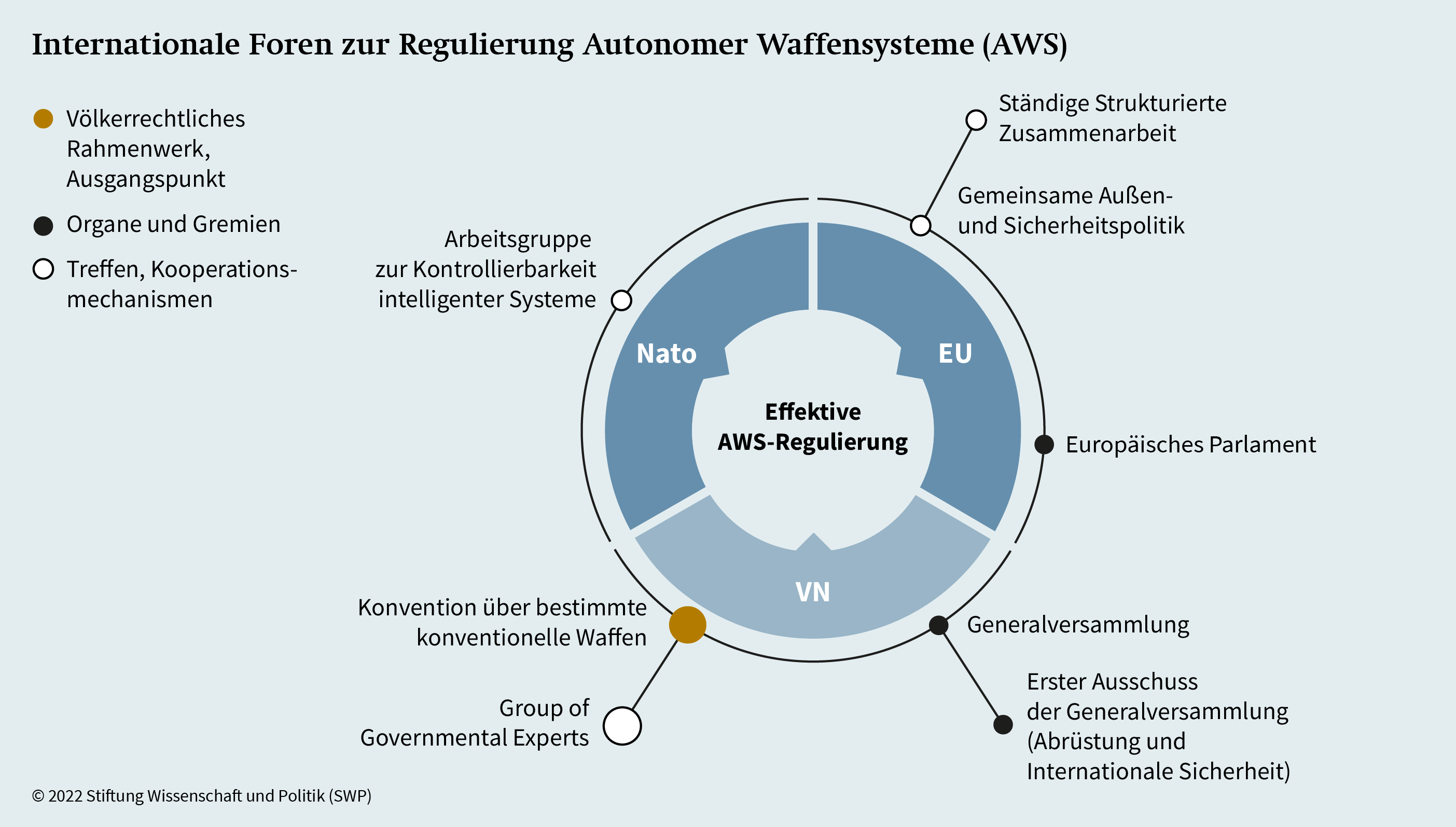

Vor allem die Nato, die EU und die VN kommen als alternative Foren für eine Regulierung von AWS in Betracht (vgl. Grafik). Überdies ist denkbar, dass andere Staaten einen Prozess initiieren, der an keine Institution angeschlossen ist.

Nato – Entwicklung einer gemeinsamen transatlantischen Linie

Auch wenn eine Regulierung von AWS nicht in den Kompetenzbereich der Nato fällt, könnte sie zumindest ein geeignetes Forum sein, um eine inhaltliche Annäherung zwischen den einzelnen Nato-Partnern in Bezug auf AWS zu erzielen, sodass diese eine stärkere Position in anderen Foren vertreten könnten, etwa im Rahmen der VN.

Die Nato hat im Herbst 2021 eine Strategie zu KI veröffentlicht, die sechs Leitprinzipien enthält, die auch für AWS relevant sind: Rechtmäßigkeit; Verantwortlichkeit und Rechenschaftspflicht; Erklärbarkeit und Nachverfolgbarkeit; Verlässlichkeit;

Regierbarkeit; Vermeidung von jeglicher Form der Voreingenommenheit. Über die konkret geforderte Mensch-Maschine-Interaktion liefert sie allerdings kaum Anhaltspunkte. Im Herbst 2022 wird die Nato den »Autonomy Implementation Plan« vorstellen. Es steht zu erwarten, dass dieses Strategiepapier deutlicher auf die Mensch-Maschine-Interaktion eingehen wird. Fraglich ist, ob der Autonomy Implementation Plan in erster Linie die US-amerikanischen Standpunkte reflektieren oder auch die Ansichten anderer Nato-Staaten ausreichend berücksichtigen wird. Die USA plädieren grundsätzlich für ein breiter gefasstes Verständnis vom Grad der Autonomie, der in Waffensystemen erlaubt sein soll. Dies hebt auch ein Papier zu Good Practices im Umgang mit AWS hervor, das die USA bei der GGE im März eingebracht haben. Daran beteiligt haben sich allerdings nur die Nato-Partner Kanada und Großbritannien sowie Australien, Japan und Südkorea.

2020 hat die Nato eine AG zur Kontrollierbarkeit intelligenter Systeme (Human Systems Integration for Meaningful Human Control over AI-based Systems) ins Leben gerufen. Die aus verschiedenen Wissenschaftlern und Wissenschaftlerinnen zusammengesetzte AG vertritt jedoch keine staatlichen Positionen, sondern erarbeitet Standpunkte aufgrund ihrer Erfahrung im Hinblick auf die Operationalisierung und Implementierung menschlicher Kontrolle über AWS. Schwierigkeiten ergeben sich für die AG beispielsweise dadurch, dass sie selbst den Begriff der »ausreichenden menschlichen Kontrolle« verwendet, den vor allem die USA ablehnen.

Die AG könnte einen positiven Beitrag leisten, indem sie neben »ausreichender menschlicher Kontrolle« noch andere Begriffe erwägt, sofern sich die inhaltliche Debatte dadurch nicht zu stark verändert und alte Konfliktlinien wieder aufbrechen. Dies könnte den USA die Möglichkeit geben, sich mit Nato-Partnern begrifflich zu einigen. Sogar das IKRK weicht in seinem Positionspapier zu AWS aus dem Jahr 2021 seine bisherige Terminologie auf und spricht nun von »menschlicher Kontrolle« und »menschlicher Beurteilung«. Die Position des IKRK könnte den Auftakt dazu bilden, die inhaltliche Diskussion auszuweiten, um für verschiedene Begriffsvarianten offen zu sein – vorausgesetzt, man ist sich über das Konzept der notwendigen Mensch-Maschine-Interaktion einig.

Schließlich darf nicht außer Acht gelassen werden, dass nicht alle europäischen Staaten auch Nato-Mitglieder sind; so sind Österreich und Irland nicht Teil derselben. Beide Länder bringen sich aber intensiv in die GGE-Verhandlungen in Genf ein und beteiligen sich an der Partnership for Peace (PfP) der Nato. Über letzteres Format könnten sie in die inhaltliche Diskussion zu AWS eingebunden werden. Russland partizipiert ebenfalls an der PfP, indes ist seine inhaltliche Beteiligung in naher Zukunft nicht zu erwarten und in Anbetracht aktueller Geschehnisse wohl auch nicht erwünscht.

Ein offener, wenngleich formloser Austausch zwischen Nato-Staaten wäre eine gute Möglichkeit, die inhaltliche Debatte über AWS zumindest aufrechtzuerhalten. Doch ebenso eine Diskussion mit Nato-Staaten und gesprächsbereiten Nicht-Nato-Staaten hätte schon einen positiven Effekt und könnte dazu beitragen, sich auf eine einheitliche Linie zu verständigen. Der Nachteil bestünde darin, dass die Nato wohl nicht mit sämtlichen Staaten in einen Dialog zu AWS träte, sondern Kooperation mit Drittstaaten schwerpunktmäßig festlegen würde.

EU – Der »Brüssel-Effekt«

Darüber hinaus sollte Deutschland auf eine stärkere inhaltliche Diskussion zu AWS innerhalb der EU drängen. Zurzeit divergieren die Auffassungen zu AWS in der EU noch leicht; wenn sich die Mitgliedstaaten auf eine gemeinsame Position einigen, könnte die EU damit zum Vorreiter internationaler Standards werden und gemäß dem »Brüssel-Effekt« weitere Nachahmer finden – so wie es im Cyberbereich bereits geglückt ist. Das Europäische Parlament hat sich schon mehrfach mit der Thematik befasst und vor allem eine rechtlich verbindliche Regulierung von AWS gefordert, während der Europäische Verteidigungsfonds nur Rüstungsprojekte fördert, die wirksamer menschlicher Kontrolle unterliegen.

Eine verstärkte inhaltliche Auseinandersetzung und die Entwicklung einer einheitlichen europäischen Linie wäre insbesondere im Rahmen der Ständigen Strukturierten Zusammenarbeit (Permanent Structured Cooperation, PESCO) sinnvoll, die 2017 ins Leben gerufen worden ist. PESCO dient als Forum bereitwilliger Staaten, Aktivitäten und Pläne für die Zukunft im Bereich der Gemeinsamen Außen- und Sicherheitspolitik (GASP) zu koordinieren. Die 25 PESCO-Staaten haben sich bereits im Rahmen gemeinsamer Rüstungsprojekte mit autonomen Funktionen von Waffensystemen beschäftigt. Zum Beispiel soll als Teil eines Projektes unter estnischer Führung, an dem Deutschland sowie neun andere EU-Mitgliedsländer mitwirken, ein unbemanntes Bodensystem (unmanned ground system) entwickelt werden. Ähnliche Projekte, oftmals mit deutscher Beteiligung, gibt es in der Marine und bei den Luftstreitkräften. So wird unter der Leitung Portugals an einem unbemannten Anti-U‑Boot-System (unmanned anti-submarine-system) gearbeitet, das mittels KI in einem etwaigen U‑Boot-Krieg eingesetzt werden soll.

Aus den öffentlich zugänglichen Daten geht nicht klar hervor, inwieweit diese Waffensysteme mit autonomen Funktionen ausgestattet sein werden. Doch ein genauerer Blick auf diese Waffensysteme sowie das Zusammenspiel zwischen Mensch und Maschine könnte wertvolle Erkenntnisse liefern, die wiederum in Diskussionen in anderen Foren einfließen könnten. Selbst wenn im Rahmen von PESCO Rüstungsprojekte im Mittelpunkt stehen, ist es dennoch denkbar und vor allem sinnvoll, auch inhaltliche Diskussionen zu führen, die in weiterer Folge andere Prozesse, etwa in der Nato und den VN, positiv beeinflussen könnten.

Vereinte Nationen – die normative Kraft von Resolutionen

Wenngleich die GGE bislang das zentrale Forum für eine inhaltliche Auseinandersetzung mit AWS war, ist nicht auszuschließen, dass der Prozess künftig in anderen Institutionen innerhalb der VN fortgeführt wird. Schon jetzt spricht sich die zivilgesellschaftliche Organisation »Campaign to Stop Killer Robots« für eine Verlagerung des Prozesses aus: In einem Statement vom März 2022 hat sie die GGE explizit für gescheitert erklärt und dazu aufgerufen, andere Foren in Betracht zu ziehen. Auch die Staaten der G13, einer überregionalen Gruppe aus lateinamerikanischen, afrikanischen und asiatischen Ländern, visieren die Befassung anderer Institutionen innerhalb der VN an. Deutschland muss sich daher auf diese Eventualität einstellen und sich überlegen, ob und unter welchen Voraussetzungen es an einem solchen Prozess teilnehmen wird. Realistischerweise kommen zwei VN-Foren als Alternative für Debatten über AWS in Frage:

An erster Stelle steht der Unterausschuss der VN-Generalversammlung (GV) zu Abrüstung und Internationaler Sicherheit, das sogenannte Erste Komitee der GV (GV1). Resolutionen im Unterausschuss werden üblicherweise im Konsensverfahren beschlossen – genau wie im Rahmen der GGE. Unwillige Staaten könnten also die Entscheidungsfindung blockieren. Allerdings können vorbereitende, nicht konsensual abgestimmte Arbeitsprozesse der GV1 als Vorlage für weitergehende Diskussionen in der GV dienen oder sogar dazu, dass die GV eine Resolution zu AWS verabschieden kann. Denn die GV ist das zweite VN-Forum, in dem AWS diskutiert werden könnten. Dort herrscht in der Regel das Mehrheitsprinzip, sodass sie auch Resolutionen gegen den Willen bestimmter Staaten beschließen kann.

Erfahrungen aus den vergangenen GGE-Gesprächen zeigen zwar, dass die Mehrheit der Staaten eine Regulierung von AWS befürwortet. Sogar China hat sich letzten Herbst in einem Positionspapier nochmals explizit dafür eingesetzt. Herausgestellt hat sich aber ebenso, dass eine Einigung nicht an mangelndem Interesse scheitert, sondern vielmehr daran, dass sich die Staaten bislang nicht darauf verständigen konnten, wie die Mensch-Maschine-Interaktion ausgestaltet werden soll. Ein Mehrwert der Befassung mit AWS durch die GV könnte in der großen politischen Signalwirkung von GV-Resolutionen liegen, obwohl das reale Risiko besteht, dass auch im Rahmen der GV keine substantiellen inhaltlichen Fortschritte erzielt werden.

Damit eine Resolution der GV hohe politische Signalwirkung entfaltet, bedarf es eines entsprechend großen Zuspruchs und eines damit einhergehenden positiven Abstimmungsverhaltens innerhalb der GV. Gerade Letzteres könnte sich in Anbetracht aktueller Konfliktlinien als schwierig erweisen. China könnte beispielsweise die Zustimmung zu einer Resolution verweigern, wenn Russland ihr nicht zustimmt. Die Unterstützung einer etwaigen Resolution zu AWS durch militärische Großmächte wäre aber erforderlich, um den Einsatz von AWS glaubhaft und vor allem nachhaltig zu regulieren.

Handlungsempfehlungen für Deutschland

Es ist sehr wahrscheinlich, dass die GGE spätestens nach Ende des zweiten diesjährigen Treffens im Juli aufgrund des russischen Boykotts offiziell als gescheitert gelten wird. Deutschland muss folglich bereits jetzt an einer Strategie für eine Zeit nach der GGE arbeiten, um seinem Vorhaben aus dem Koalitionsvertrag, an einer Ächtung von AWS aktiv mitzuwirken, nachzukommen.

Dafür braucht es eine nationale Positionierung zu AWS, die sowohl zwischen voll- und teilautonomen Waffensystemen unterscheiden als auch konkrete Anhaltspunkte zur notwendigen Mensch-Maschine-Interaktion geben sollte. Jedoch wäre es sinnvoll, wenn sich die Definition nicht auf letale Waffensysteme beschränkt. Nachdem sich unter anderem die USA weigern, den Begriff »menschliche Kontrolle« zu akzeptieren, könnte sich Deutschland dem Ansatz des IKRK anschließen, von »menschlicher Kontrolle« und »menschlicher Beurteilung« zu sprechen. Zudem könnte die geplante Nationale Sicherheitsstrategie (NSS) einen Abschnitt zu AWS und neuen Waffentechnologien enthalten. Vorbild für diesen Teil der NSS könnte eine jüngst von der Schweiz verabschiedete Strategie zu Rüstungskontrolle und Abrüstung sein.

Der russische Angriffskrieg gegen die Ukraine scheint einen Paradigmenwechsel im Bereich Rüstungskontrolle zu markieren: Universelle Foren treten zunehmend in den Hintergrund, regionale Institutionen, wie Nato und EU, gewinnen an Bedeutung. In regionalen Foren lassen sich Fragen zu AWS aber nicht abschließend und schon gar nicht inklusiv klären. Ihre Diskussion innerhalb von Nato und EU könnte aber zumindest bewirken, dass Bündnispartner ihre Standpunkte stärker aufeinander abstimmen und mittel- wie auch längerfristig mit geeinter Stimme in weitere Verhandlungen gehen.

Deutschland sollte sich darüber hinaus auf eine inhaltliche Diskussion über AWS in der GV1 vorbereiten, da vor allem die G13-Staaten einen derartigen Prozess initiieren könnten. Ein koordiniertes Vorgehen der Nato-Partner und der EU-Mitglieder könnte dazu beitragen, breite Mehrheiten in den einzelnen Institutionen der VN zu finden.

Keines der in Betracht zu ziehenden Foren garantiert angesichts der aktuellen Umstände Erfolg. Es wäre allerdings nicht zielführend, deshalb die Diskussion über AWS zum Erliegen kommen zu lassen. Gerade der Einsatz neuer Technologien im Krieg in der Ukraine zeigt deutlich, dass Autonomie in Waffensystemen eine immer größere Rolle spielt. Die angekündigte Zeitenwende sollte Anlass sein, die Komplexität von Autonomie in Waffensystemen zu reflektieren, unter anderem mit einer entsprechenden nationalen Positionierung zu AWS. So könnte Deutschland der Welt signalisieren, dass es seine im Koalitionsvertrag gemachten Versprechen auch in die Tat umsetzt.

Dr. Elisabeth Hoffberger-Pippan ist Wissenschaftlerin der Forschungsgruppe Sicherheitspolitik und leitet dort das Projekt »The International Panel on the Regulation of Autonomous Weapons« (iPRAW). Vanessa Vohs und Paula Köhler sind Forschungsassistentinnen der Forschungsgruppe Sicherheitspolitik und für iPRAW. iPRAW wird aus Mitteln des Auswärtigen Amtes finanziert, ist ein unabhängiges Gremium und setzt sich aus Forscherinnen und Forschern aus verschiedenen Fachdisziplinen zusammen.

© Stiftung Wissenschaft und Politik, 2022

Alle Rechte vorbehalten

Das Aktuell gibt die Auffassung der Autorinnen wieder.

SWP-Aktuells werden intern einem Begutachtungsverfahren, einem Faktencheck und einem Lektorat unterzogen. Weitere Informationen zur Qualitätssicherung der SWP finden Sie auf der SWP-Website unter https://www. swp-berlin.org/ueber-uns/ qualitaetssicherung/

SWP

Stiftung Wissenschaft und Politik

Deutsches Institut für Internationale Politik und Sicherheit

Ludwigkirchplatz 3–4

10719 Berlin

Telefon +49 30 880 07-0

Fax +49 30 880 07-100

www.swp-berlin.org

swp@swp-berlin.org

ISSN (Print) 1611-6364

ISSN (Online) 2747-5018

doi: 10.18449/2022A36